Dalam beberapa tahun terakhir, keamanan biometrik di era deepfake menjadi sorotan karena meningkatnya kasus penyalahgunaan identitas digital. Ponsel pintar, layanan perbankan, dan aplikasi finansial sangat mengandalkan sistem autentikasi berbasis biometrik. Ketika deepfake berkembang semakin realistis, sistem ini mulai menghadapi risiko yang belum pernah terjadi. Penjahat digital kini dapat meniru wajah atau suara seseorang dengan tingkat presisi yang mengkhawatirkan. Kondisi ini membuat keamanan biometrik di era deepfake semakin dipertanyakan, terutama pada layanan keuangan dan bisnis yang melibatkan transaksi bernilai besar.

Ancaman nyata terhadap keamanan biometrik di era deepfake

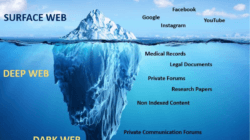

Deepfake memanfaatkan kecerdasan buatan untuk menciptakan konten palsu yang hampir tidak bisa dibedakan dari aslinya. Fakta bahwa suara dan wajah dapat dipalsukan menjadikan keamanan biometrik di era deepfake semakin rapuh. Berbagai laporan internasional menunjukkan adanya kasus kejahatan yang memanfaatkan deepfake untuk menipu perusahaan besar. Sejumlah eksekutif ditipu melalui panggilan suara palsu, mengakibatkan kerugian finansial bernilai jutaan dolar. Fenomena ini membuktikan bahwa keamanan biometrik di era deepfake memerlukan inovasi baru.

Pada sistem pengenalan wajah, deepfake mampu meniru ekspresi dan pola gerakan dengan sangat halus. Model AI mampu mempelajari wajah seseorang hanya dari foto yang beredar di media sosial. Hal ini memperbesar risiko kebocoran data biometrik. Karena itu, keamanan biometrik di era deepfake harus memasukkan lapisan pertahanan tambahan untuk mencegah penyalahgunaan ini.

Pada autentikasi suara, ancaman deepfake tidak kalah besar. Klip audio pendek bisa menjadi dasar untuk mereplikasi suara seseorang secara sintetis. Penjahat siber dapat menggunakan audio deepfake untuk mengakses sistem perbankan yang berbasis verifikasi suara. Kondisi ini semakin memperjelas bahwa keamanan biometrik di era deepfake menuntut evaluasi menyeluruh.

Aaf Afiatna (Aura OS) adalah seorang WordPress Developer, Administrator IT, dan penggerak di balik infrastruktur berbagai portal media digital PT Arina Duta Sehati. Ia memiliki ketertarikan mendalam pada rekayasa sistem tingkat rendah, implementasi AI on-device, dan pengembangan proyek open-source seperti Neural Standby Kernel (NSK). Saat tidak sedang berurusan dengan server atau kode, ia aktif mengeksplorasi ekosistem Web3 dan berbagi wawasan melalui channel YouTube CryptoFansWorld.