Furiosa AI Perkenalkan RNGD, Akselerator Inferensi Pusat Data yang Tantang Dominasi GPU

Info Tekno> Furiosa AI memperkenalkan RNGD sebagai akselerator inferensi pusat data berbasis arsitektur Tensor Contraction Processor (TCP) yang dirancang khusus untuk beban kerja kecerdasan buatan (AI) modern, khususnya model bahasa besar (LLM). Perusahaan rintisan semikonduktor ini menyatakan pendekatannya berbeda dari GPU konvensional karena sejak awal dibangun dengan kontraksi tensor sebagai primitif fundamental perangkat keras.

Pengumuman dan penjelasan mengenai teknologi ini disampaikan oleh Alex Liu, SVP Produk dan Bisnis di Furiosa AI, dalam perbincangan mengenai arah pengembangan chip AI yang dinilai semakin dibatasi oleh konsumsi daya, pendinginan, dan biaya operasional pusat data.

Dari Inspirasi Mad Max ke Arsitektur AI Modern

Asal-usul Nama Furiosa AI

Nama Furiosa AI terinspirasi dari karakter Furiosa dalam waralaba film Mad Max yang kemudian berkembang melalui sejumlah sekuel seperti Mad Max 2, Mad Max Beyond Thunderdome, Mad Max: Fury Road, hingga Furiosa: A Mad Max Saga. Pendiri dan CEO perusahaan disebut sebagai penggemar berat seri tersebut dan mengadopsi semangat ketangguhan serta momentum karakter Furiosa sebagai identitas perusahaan.

Namun, alih-alih membangun kendaraan tempur pasca-apokaliptik, Furiosa AI mengembangkan chip akselerator inferensi pusat data bernama RNGD—dibaca “Renegade”—yang secara eksplisit diposisikan sebagai alternatif arsitektur terhadap GPU tradisional.

Mengapa Furiosa AI Menilai GPU Tidak Ideal untuk Inferensi Jangka Panjang?

GPU Diciptakan untuk Piksel, AI Membutuhkan Tensor

Menurut Furiosa AI, GPU pada dasarnya dirancang untuk memproses piksel dan beban kerja grafis berbasis Single Instruction Multiple Threads (SIMT). Dalam perkembangannya, GPU memang diadaptasi untuk menangani komputasi AI melalui unit matriks dan core khusus, tetapi secara arsitektural bukan dibangun dari awal untuk inferensi model bahasa besar.

Perusahaan berargumen bahwa AI modern—khususnya transformer dan LLM—bertumpu pada operasi kontraksi tensor multidimensi. Jika perkalian matriks adalah operasi dua dimensi, maka kontraksi tensor merupakan generalisasi multidimensi yang lebih kompleks dan menjadi fondasi hampir seluruh perhitungan model AI kontemporer.

Di sinilah letak pendekatan berbeda Furiosa AI: mereka memperlakukan kontraksi tensor sebagai primitif fundamental perangkat keras, bukan sekadar beban kerja yang dipetakan ke unit matriks seperti pada GPU.

Arsitektur Tensor Contraction Processor (TCP)

Konsep Dasar Kontraksi Tensor

Secara matematis, kontraksi tensor adalah proses perkalian dan penjumlahan pada dimensi yang sama dalam struktur multidimensi. Dalam praktiknya pada model AI, operasi ini menjadi tulang punggung komputasi, terutama dalam arsitektur transformer.

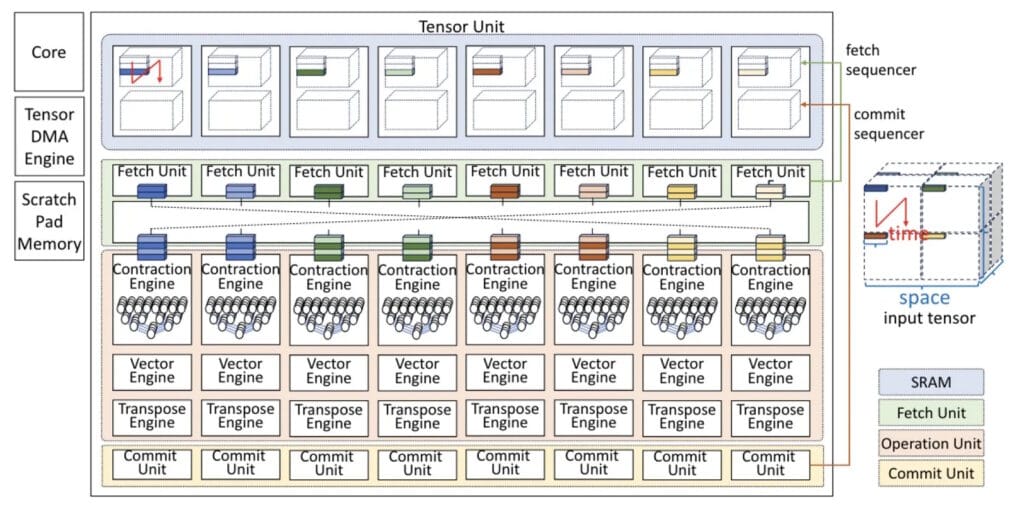

Alih-alih memetakan kontraksi tensor ke unit matriks tetap, arsitektur Tensor Contraction Processor (TCP) milik Furiosa AI memperlakukan kontraksi tensor sebagai model eksekusi asli (native execution model). Artinya, perangkat keras “berpikir” dalam struktur tensor sejak awal desain.