AI Bukan Fenomena Baru: Akar Panjang Kecerdasan Buatan

Kecerdasan Buatan atau Artificial Intelligence (AI) kerap dianggap sebagai produk era modern—identik dengan chatbot, mobil otonom, atau sistem rekomendasi canggih. Namun, jika ditelusuri lebih dalam, AI bukanlah konsep yang lahir tiba-tiba. Istilah “Artificial Intelligence” memang pertama kali diperkenalkan secara resmi pada Konferensi Dartmouth tahun 1956, tetapi fondasi pemikirannya telah dibangun jauh sebelumnya, bahkan sebelum komputer digital diciptakan.

Perjalanan AI adalah kisah panjang lintas disiplin: filsafat, logika, matematika, hingga ilmu komputer. Ini adalah upaya manusia untuk mentransfer kemampuan berpikir, bernalar, dan belajar ke dalam mesin—sebuah ambisi intelektual yang terus berevolusi hingga hari ini.

Menurut Dr. Lukas, Dosen BINUS University sekaligus Ketua Indonesia Artificial Intelligence Society (IAIS), sejarah AI tidak dapat dipahami hanya sebagai kemajuan teknologi, melainkan sebagai perkembangan pemikiran manusia dalam merepresentasikan kecerdasan secara sistematis.

Benih Awal AI: Fondasi Logika dan Matematika (Pra-1950)

Jauh sebelum istilah AI dikenal, para pemikir telah merumuskan dasar-dasar logika yang kelak menjadi “bahasa” mesin.

Pada awal abad ke-20, George Boole memperkenalkan Aljabar Boolean, sistem logika berbasis nilai benar dan salah (true/false) yang kini direpresentasikan sebagai 0 dan 1 dalam sistem biner. Tanpa konsep ini, komputer modern tidak akan pernah ada.

Upaya lanjutan dilakukan oleh Alfred North Whitehead dan Bertrand Russell melalui karya monumental Principia Mathematica, yang berambisi merumuskan seluruh pengetahuan logis manusia ke dalam sistem simbolik. Namun, ambisi tersebut kemudian dipatahkan oleh Kurt Gödel melalui Teorema Ketidaklengkapan (1931), yang membuktikan bahwa tidak ada sistem logika yang sepenuhnya lengkap dan bebas dari kontradiksi.

Di dekade 1930-an, Alan Turing memperkenalkan konsep Turing Machine dan Tes Turing, yang hingga kini masih menjadi tolok ukur filosofis kecerdasan mesin. Menariknya, prinsip Tes Turing kini dapat ditemukan secara praktis dalam sistem verifikasi seperti CAPTCHA, pengalaman yang akrab bagi pengguna internet modern.

Fondasi lain diperkuat oleh Claude Shannon dengan Teori Informasi dan John von Neumann dengan arsitektur komputer modern, yang memisahkan perangkat keras dan perangkat lunak—konsep fundamental yang masih digunakan hingga saat ini.

Gelombang Pertama AI: Kelahiran Istilah dan Optimisme Awal (1950-an)

Memasuki era pasca Perang Dunia II, komputer digital mulai digunakan secara luas. Momentum ini mencapai puncaknya pada 1956, ketika John McCarthy memperkenalkan istilah Artificial Intelligence dalam pertemuan ilmiah di Dartmouth.

Bersama tokoh-tokoh seperti Marvin Minsky, Herbert Simon, Allen Newell, dan Edward Feigenbaum, AI dipandang sebagai bidang yang mampu membuat mesin “berpikir” seperti manusia.

Hasil penting dari era ini meliputi:

- LISP, bahasa pemrograman yang dirancang khusus untuk AI

- Semantic Network dan Frame, metode representasi pengetahuan

- Expert System dan General Problem Solver, program awal pemecahan masalah kompleks

Era ini ditandai oleh optimisme tinggi, meski keterbatasan komputasi dan data kemudian memperlambat laju perkembangan.

Gelombang Kedua AI: Mesin Mulai Belajar dari Data (1980-an)

Tahun 1980-an menandai gelombang kedua AI, ketika fokus beralih dari simbol dan aturan ke data dan probabilitas.

Tokoh-tokoh seperti David Rumelhart memperkenalkan Multi-Layer Perceptron (MLP), cikal bakal jaringan saraf modern. Lotfi Zadeh mengembangkan Logika Fuzzy, memungkinkan mesin bernalar dalam kondisi tidak pasti—lebih mendekati cara manusia berpikir.

Selain itu, lahir pula berbagai algoritma evolusioner seperti Genetic Algorithm dan Genetic Programming, yang terinspirasi dari mekanisme seleksi alam. Pendekatan ini memperluas cara mesin belajar dan beradaptasi.

Gelombang Ketiga AI: Internet, Big Data, dan Deep Learning (2000-an)

Memasuki abad ke-21, AI mendapatkan “bahan bakar” terbesarnya: data masif dan konektivitas global. Internet, World Wide Web, IoT, dan komputasi awan menciptakan lingkungan ideal bagi pembelajaran mesin.

Puncaknya terjadi pada 2006, ketika Geoffrey Hinton memperkenalkan kembali konsep Deep Learning. Sejak saat itu, AI mengalami lonjakan kemampuan dalam pengenalan gambar, suara, dan bahasa alami—fondasi dari teknologi AI modern yang kita gunakan sehari-hari.

Kerangka Evolusi AI Menurut Dr. Lukas

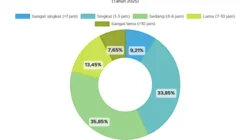

Dr. Lukas merangkum sejarah AI ke dalam empat tahap utama:

- Tahap Teoretis: Fondasi logika dan matematika

- Gelombang Pertama: Representasi pengetahuan

- Gelombang Kedua: Pembelajaran berbasis data

- Gelombang Ketiga: Big Data dan Deep Learning

Kerangka ini membantu memahami AI sebagai proses evolutif, bukan lompatan instan.

Kesimpulan: AI sebagai Cerminan Ambisi Manusia

Sejarah kecerdasan buatan adalah cerminan dari ambisi manusia untuk memahami dan mereplikasi kecerdasannya sendiri. Dari aljabar Boolean hingga deep learning, AI terus berkembang sebagai kekuatan sentral dalam teknologi global.

Dengan fondasi ilmiah yang kuat dan dukungan data yang terus bertambah, AI bukan hanya masa depan—ia telah menjadi bagian dari realitas kita hari ini, dan akan terus membentuk arah peradaban digital di masa mendatang.

Aaf Afiatna (Aura OS) adalah seorang WordPress Developer, Administrator IT, dan penggerak di balik infrastruktur berbagai portal media digital PT Arina Duta Sehati. Ia memiliki ketertarikan mendalam pada rekayasa sistem tingkat rendah, implementasi AI on-device, dan pengembangan proyek open-source seperti Neural Standby Kernel (NSK). Saat tidak sedang berurusan dengan server atau kode, ia aktif mengeksplorasi ekosistem Web3 dan berbagi wawasan melalui channel YouTube CryptoFansWorld.